没有合适的资源?快使用搜索试试~ 我知道了~

资源推荐

资源详情

资源评论

格式:pdf 资源大小:2.2MB 页数:333

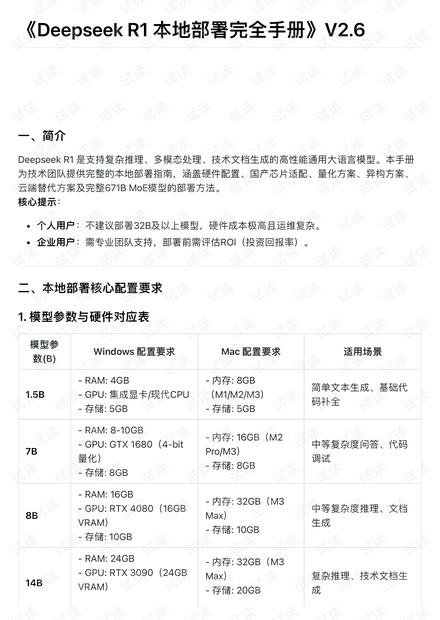

《Deepseek R1 本地部署完全⼿册》V2.6

⼀、简介

Deepseek R1 是⽀持复杂推理、多模态处理、技术⽂档⽣成的⾼性能通⽤⼤语⾔模型。本⼿册

为技术团队提供完整的本地部署指南,涵盖硬件配置、国产芯⽚适配、量化⽅案、异构⽅案、

云端替代⽅案及完整671B MoE模型的部署⽅法。

核⼼提示:

个⼈⽤户:不建议部署32B及以上模型,硬件成本极⾼且运维复杂。

企业⽤户:需专业团队⽀持,部署前需评估ROI(投资回报率)。

⼆、本地部署核⼼配置要求

1. 模型参数与硬件对应表

模型参

数(B)

Windows 配置要求 Mac 配置要求 适⽤场景

1.5B

- RAM: 4GB

- GPU: 集成显卡/现代CPU

- 存储: 5GB

- 内存: 8GB

(M1/M2/M3)

- 存储: 5GB

简单⽂本⽣成、基础代

码补全

7B

- RAM: 8-10GB

- GPU: GTX 1680(4-bit

量化)

- 存储: 8GB

- 内存: 16GB(M2

Pro/M3)

- 存储: 8GB

中等复杂度问答、代码

调试

8B

- RAM: 16GB

- GPU: RTX 4080(16GB

VRAM)

- 存储: 10GB

- 内存: 32GB(M3

Max)

- 存储: 10GB

中等复杂度推理、⽂档

⽣成

14B

- RAM: 24GB

- GPU: RTX 3090(24GB

VRAM)

- 内存: 32GB(M3

Max)

- 存储: 20GB

复杂推理、技术⽂档⽣

成

- 存储: 20GB

32B

企业级部署(需多卡并

联)

暂不⽀持

科研计算、⼤规模数据

处理

70B

企业级部署(需多卡并

联)

暂不⽀持

⼤规模推理、超复杂任

务

671B

企业级部署(需多卡并

联)

暂不⽀持

超⼤规模科研计算、⾼

性能计算

2. 算⼒需求分析

模型版本

参数

(B)

计算

精度

模型⼤⼩

VRAM 要

求(GB)

参考GPU配置

DeepSeek-

R1

671B FP8 ~1,342GB ≥1,342GB

多GPU配置(如:NVIDIA A100

80GB *16)

DeepSeek-

R1-Distill-

Llama-70B

70B BF16 43GB ~32.7GB

多GPU配置(如:NVIDIA A100

80GB *2 4位量化+模型并⾏)、

单卡H100 80G 4位量化+内存优

化、 4 *RTX4090 24G 4位量化

+张量并⾏

DeepSeek-

R1-Distill-

Qwen-32B

32B BF16 20GB ~14.9GB

多GPU配置(如:NVIDIA RTX

4090 *4 NBLink桥接)、单卡

A100 80G 4位量化、2 *A10 24G

DeepSeek-

R1-Distill-

Qwen-14B

14B BF16 9GB ~6.5GB NVIDIA RTX 3080 10GB 或更⾼

DeepSeek-

R1-Distill-

Llama-8B

8B BF16 4.9GB ~3.7GB

NVIDIA RTX 3070 8GB 、3090

24G、4090 24G、A10 24G或更

⾼

DeepSeek-

R1-Distill-

Qwen-7B

7B BF16 4.7GB ~3.3GB NVIDIA RTX 3070 8GB 或更⾼

DeepSeek-

R1-Distill-

Qwen-1.5B

1.5B BF16 1.1GB ~0.7GB

NVIDIA RTX 3060 12GB、T4

16G、GTX1660 6G或更⾼

算⼒匹配:

补充说明:

1. VRAM 要求:表中列出的VRAM需求为最低要求,实际部署时建议预留20%-30%的额外显

存以应对模型加载和运⾏中的峰值需求。

2. 多GPU配置:对于⼤规模模型(如32B+),建议使⽤多GPU并联以提升计算效率和稳定

性。

3. 计算精度:FP8和BF16为当前主流的⾼效计算精度,能够在保证模型性能的同时降低显存

占⽤。

4. 适⽤场景:不同参数规模的模型适⽤于不同复杂度的任务,⽤户可根据实际需求选择合适

的模型版本。

5. 企业级部署:对于671B等超⼤规模模型,建议使⽤专业级GPU集群(如NVIDIA A100)进

⾏部署,以满⾜⾼性能计算需求。

三、国产芯⽚与硬件适配⽅案

1. 国内⽣态合作伙伴动态

企业 适配内容

性能对标(vs

NVIDIA)

华为昇

腾

昇腾910B原⽣⽀持R1全系列,提供端到端推理优化

⽅案

等效A100(FP16)

沐曦

GPU

MXN系列⽀持70B模型BF16推理,显存利⽤率提升

30%

等效RTX 3090

海光

DCU

适配V3/R1模型,性能对标NVIDIA A100 等效A100(BF16)

** 华为国产系列 **

⽀持V3和R1全系列私有部署

剩余18页未读,继续阅读

资源评论

西毒欧阳风2025-04-30资源使用价值高,内容详实,给了我很多新想法,感谢大佬分享~

西毒欧阳风2025-04-30资源使用价值高,内容详实,给了我很多新想法,感谢大佬分享~ 刘彬Y(^_^)Y2025-03-28资源中能够借鉴的内容很多,值得学习的地方也很多,大家一起进步!

刘彬Y(^_^)Y2025-03-28资源中能够借鉴的内容很多,值得学习的地方也很多,大家一起进步! alan88wang2025-04-07资源内容详细,总结地很全面,与描述的内容一致,对我启发很大,学习了。

alan88wang2025-04-07资源内容详细,总结地很全面,与描述的内容一致,对我启发很大,学习了。 sinat_331755982025-04-07发现一个超赞的资源,赶紧学习起来,大家一起进步,支持!

sinat_331755982025-04-07发现一个超赞的资源,赶紧学习起来,大家一起进步,支持!

每天读点书学堂

- 粉丝: 1452

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功